kt클라우드, ‘클라우드 기반 NPU 인프라’ 국내 상용화

국내 클라우드 기반 NPU 인프라, 리벨리온의 고성능 NPU ‘아톰’ 탑재…사용 편의성↑, AI 분야 기간·비용 혁신

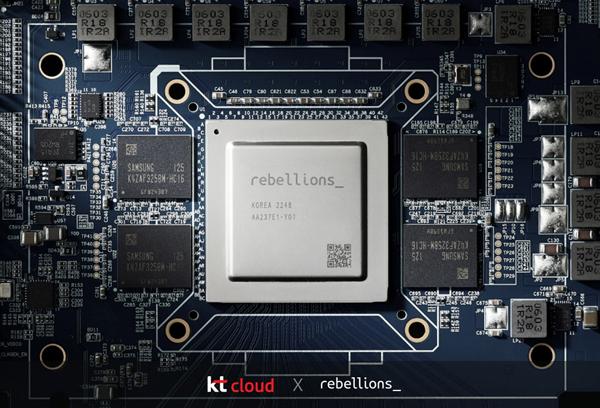

(서울=NSP통신) 이복현 기자 = kt클라우드(대표 윤동식)가 토종 팹리스(반도체 설계 전문기업) 리벨리온의 ‘아톰’을 적용한 클라우드 기반 NPU(신경망처리장치) 인프라 서비스를 지난 5월 30일 시작했다.

NPU는 AI 분야에 최적화된 설계로 AI 반도체로 불리며 동급의 GPU 대비 연산 속도가 빠르고 전력 소모는 낮다는 것이 강점이다.

kt클라우드는 NPU를 클라우드 기반으로 이용할 수 있도록 플랫폼에 적용하고, NPU 자원 공유 풀 구성‧관리 및 오토 프로비저닝 구현 등을 통해 서비스화 했다. 기업들은 전용 포털을 통해 쉽고 간편하게 NPU 기반의 AI 추론을 진행할 수 있다.

클라우드 기반 NPU 인프라는 클릭 몇 번으로 고객이 직접 자원을 생성하고, 연산 세션을 활용하고, 관리‧모니터링 등을 할 수 있어 구축형 인프라 대비 사용 편의성이 높다. 더불어 고성능·저전력의 NPU 특성이 필요할 때 필요한 만큼 이용할 수 있는 환경을 제공함으로써 AI 분야 기업들의 연구 기간·비용 혁신을 한번 더 가져온다.

이 서비스는 언어 및 비전 모델 지원이 필요한 관제, 의료 등 이미지 처리 기반 산업 분야와 고객 서비스, 교육 등 자연어 처리 기반 산업 분야의 다양한 기업들에게 제공된다.

kt클라우드는 NPU 인프라를 AI반도체 초기 시장 수요 창출 지원, 중소·벤처기업 대상 국산 AI반도체 기반 컴퓨팅 자원 지원을 목적으로 하는 K-클라우드 프로젝트 지원사업 중 ‘AI바우처 지원사업’과 ‘고성능컴퓨팅 지원사업’ 대상 기업에게 먼저 제공하고, 올해 하반기 중 기업 고객 대상으로 서비스를 확대할 계획이다.

이번 서비스에 탑재된 리벨리온의 아톰은 금융 거래에 특화된 AI 반도체 아이온에 이어 리벨리온이 두번째로 선보이는 AI 반도체로 국내 타 팹리스가 개발중인 2세대 NPU 수준의 성능을 이미 갖춘 상태다.

아톰은 트랜스포머 언어 모델과 부동 소수점 연산을 지원하는 유일한 국산 NPU다. AI 반도체 기술력 검증 대회인 ‘엠엘퍼프(MLPerf)’ 결과에 따르면 아톰은 엔비디아의 A2와 T4, 퀄컴의 클라우드 AI 100 대비, 영상처리(ResNet)의 경우 1.4배~3.4배, 언어 모델(BERT-Large)은 1.4배~2배 빠른 것으로 확인됐다.

게다가 최대 60 와트(Watt) 저전력 설계와 삼성 5나노 EUV(극자외선) 공정 제조로 업계에 주로 사용 중인 GPU와 비교하면 비전모델은 약 6배, 언어모델은 약 2배 전력 효율이 높다.

리벨리온은 아톰의 성능을 보다 업그레이드한 버전도 준비 중이며 이에 맞춰 kt클라우드의 NPU 인프라를 고도화하고, 24년 이후에는 차기 NPU모델인 ‘리벨(Rebel)’을 선보일 계획이다.

리벨리온 박성현 대표는 이번 NPU 인프라 서비스에 대해 “최근 엠엘퍼프에서 비전과 언어 모델 모두에서 글로벌 탑티어 수준의 역량을 입증한 아톰이 kt클라우드의 클라우드 서비스를 통해 데이터센터에 상용된 데 자부심이 있다”며 “리벨리온의 기술력을 토대로 대한민국 AI산업 활성화에 기여하고 앞으로도 AI반도체 시장을 리딩해 갈 것”이라고 밝혔다.

kt클라우드는 향후 NPU 팜(Farm)과 클라우드 플랫폼을 설계·구축하고, 다양한 AI 응용서비스 실증을 통해 AI 반도체 레퍼런스를 확보할 계획이다. 또 2025년까지 글로벌 시장에 진출한다는 목표다.

kt클라우드 윤동식 대표는 “kt클라우드는 초거대 AI를 위한 종량제 AI 인프라 서비스인 하이퍼스케일 AI 컴퓨팅(HAC)을 출시해 AI 산업의 문턱을 낮춘데 이어 국내 클라우드 기반 NPU 인프라 상용화로 AI 분야 혁신을 이끌고 있다”며 “앞으로도 AI 인프라 혁신과 AI 반도체 고도화로 대한민국 초거대 AI 산업 활성화에 앞장 설 것”이라고 밝혔다.

ⓒ한국의 경제뉴스통신사 NSP통신·NSP TV. 무단전재-재배포 금지.

![[NSPAD]LG그룹](https://file.nspna.com/ad/T01_lgfuture_3989.gif)

![[NSP7컷]인터넷은행의 혁신적인 배신 [NSP7컷]인터넷은행의 혁신적인 배신](https://file.nspna.com/news/2023/05/30/photo_20230530123951_639759_0.jpg)

![[NSP PHOTO][업앤다운]게임주 상승…컴투스홀딩스↑·팡스카이↓](https://file.nspna.com/news/2024/11/22/20241122172247_728271_0.jpg)

![[NSP PHOTO][업앤다운]은행주 상승…하나금융↑·제주은행↓](https://file.nspna.com/news/2024/11/22/20241122163843_728238_0.jpg)

![[NSP PHOTO][업앤다운]건설주 상승…두산에너빌리티↑·코오롱글로벌↓](https://file.nspna.com/news/2024/11/22/20241122165108_728228_0.png)

![[NSP PHOTO][들어보니]해외수주 1, 2위 다툰 삼성물산·현대건설 뒷걸음질..대내외적 원인](https://file.nspna.com/news/2024/11/05/20241105174215_725327_0.png)

![[NSP PHOTO][들어보니]인터넷은행 등 가상계좌 악용 청소년 범죄↑…은행권 작정하고 속이면 심사통과](https://file.nspna.com/news/2024/03/18/20240318130327_688317_0.jpg)

![[NSP PHOTO][들어보니]홍콩ELS 0~100% 배상안에 은행권 차라리 신속히 이사회 설득해야](https://file.nspna.com/news/2024/03/11/20240311140210_687034_0.jpg)

![농협은행[N06] [NSPAD]농협은행](https://file.nspna.com/ad/N06_nhbank_4306.jpg)

![KB국민카드[N06] [NSPAD]KB국민카드](https://file.nspna.com/ad/N06_KBCARD_4299.jpg)

![토스[N06] [NSPAD]토스](https://file.nspna.com/ad/N06_toss_4292.png)

![KB금융지주[N06] [NSPAD]KB금융지주](https://file.nspna.com/ad/N06_kbjiju_4291.gif)

![종근당[N06][N06_jonggdang_4289] [NSPAD]종근당](https://file.nspna.com/ad/N06_jonggdang_4289.png)

![스마일게이트[N06][N06_smilegate_4287] [NSPAD]스마일게이트](https://file.nspna.com/ad/N06_smilegate_4287.jpg)

![기업은행[N06] [NSPAD]기업은행](https://file.nspna.com/ad/N06_IBKBANK_4285.png)

![하나금융[N06] [NSPAD]하나금융](https://file.nspna.com/ad/N06_hanagroup_4283.jpg)

![한진[N06] [NSPAD]한진](https://file.nspna.com/ad/N06_hanjin_4282.png)

![국민은행[N06] [NSPAD]국민은행](https://file.nspna.com/ad/N06_kbstar_4280.jpg)

![영풍[N06][N06_ypung_4279] [NSPAD]영풍](https://file.nspna.com/ad/N06_ypung_4279.png)

![HD현대[N06][N06_HDHKCHUSUN_4278] [NSPAD]HD현대](https://file.nspna.com/ad/N06_HDHKCHUSUN_4278.jpg)

![삼성SDI[N06] [NSPAD]삼성SDI](https://file.nspna.com/ad/N06_samsungsdi_4277.png)

![CJ올리브영[N06][N06_CJGROUP_4276] [NSPAD]CJ올리브영](https://file.nspna.com/ad/N06_CJGROUP_4276.png)

![위메이드[N06][N06_wemade_4269] [NSPAD]위메이드](https://file.nspna.com/ad/N06_wemade_4269.jpg)

![[NSP PHOTO][금융업계기상도]신한은행 맑음·NH농협은행 흐림](https://file.nspna.com/news/2024/11/22/20241122160608_728217_0.jpg)

![[NSP PHOTO][금융업계기상도]카카오뱅크 맑음·케이뱅크 구름조금](https://file.nspna.com/news/2024/11/15/20241115153449_727092_0.jpg)

![[NSP PHOTO][금융업계기상도]우리은행 비온뒤갬·케이뱅크 흐림](https://file.nspna.com/news/2024/11/08/20241108174637_725979_0.jpg)

![[NSP PHOTO]대출 한파에 은행앱 사실상 개점휴업…카드론 급전 창구 역할 심각](https://file.nspna.com/news/2024/11/21/photo_20241121121742_727902_0.jpg)

![[NSP PHOTO]부당대출 조병규 우리은행장 피의자 전환…기소 여부 촉각](https://file.nspna.com/news/2024/11/19/photo_20241119151835_727503_0.jpg)

![[NSP PHOTO]은행 가계대출 1000조원 코앞…GDP대비 91.1%](https://file.nspna.com/news/2024/11/19/photo_20241119103149_727414_0.jpg)

![[NSP PHOTO]한남4구역 경쟁력…삼성물산 희소성, 현대건설 대단지 구축](https://file.nspna.com/news/2024/11/22/photo_20241122163616_728201_0.png)

![[NSP PHOTO]DL, 캐나다 비료공장 프로젝트 계약 기대…약 486억 규모](https://file.nspna.com/news/2024/11/21/photo_20241121104306_727858_0.jpg)

![[NSP PHOTO]은행 3분기 누적 이자이익 44조 4000억원](https://file.nspna.com/news/2024/11/19/photo_20241119100444_727408_0.jpg)

![[NSP PHOTO]김승모 한화 건설부문 대표 사업 기대 실적 위협 요소](https://file.nspna.com/news/2024/11/14/photo_20241114095428_726731_0.jpg)

![[NSP PHOTO]게임이용장애 질병 분류는 부당…K-GAMES, WHO-FIC 의견서 제출](https://file.nspna.com/news/2024/11/12/photo_20241112181617_726477_0.jpg)

![[NSP PHOTO]비상 걸린 비상금대출…20대, 중·저신용자 몰려 연체율↑](https://file.nspna.com/news/2024/11/20/photo_20241120150609_727701_0.jpg)

![[NSP PHOTO]우정사업본부 우체국쇼핑, 플래티어 그루비 도입](https://file.nspna.com/news/2024/11/19/photo_20241119102559_727411_0.jpg)

![[NSP PHOTO]시프트업 3Q 영업이익 356억원 기록…전년比 120.4%↑·전분기比 21%↓](https://file.nspna.com/news/2024/11/18/photo_20241118161021_727322_0.jpg)

![[NSP PHOTO]넷마블 신작 세븐나이츠 리버스 첫 공개…내년 출시 목표](https://file.nspna.com/news/2024/11/16/photo_20241116181341_727183_0.jpg)

![[NSP PHOTO][타보니]혼다 CR-V 하이브리드, 2.0L 직분사 앳킨슨 엔진·E-CVT 변속기 조화로 소음·진동 개선](https://file.nspna.com/news/2024/11/21/20241121160311_727980_0.jpg)

![[NSP PHOTO][타보니]르노 그랑 콜레오스 하이브리드, 가성비·연비 흠잡을 데 없는 SUV](https://file.nspna.com/news/2024/11/19/20241119163226_727533_0.jpg)

![[NSP PHOTO][타보니]K8 하이브리드, 기아의 새 시작 알리는 정통 세단](https://file.nspna.com/news/2024/11/11/20241111153530_726143_0.jpg)